넷마블은 감사위원 등 사외이사

대상의 인공지능(AI) 교육을 가장 활발하게 시행하는 게임사다. 이사회 내 ESG 위원회가 AI 거버넌스를 중대 이슈로 분류하고 정기적인 보고를 받았다. 기술 도입에 그치지 않고 이사회 산하 ESG 위원회가 의사결정에 나서고 있다.

실무 조직인 AI&Tech Lab부터 자체적으로 수립한 바른 AI 윤리원칙 등으로 체계적인 거버넌스 체계를 구축했다. 글로벌 규제 환경에 발맞춘 행보로 풀이된다. 다만 잠시 공백이 된 C레벨 수장의 자리는 빠르게 채워야할 것으로 진단된다.

◇AI 단일 주제로 이사회 교육…ESG 위원회가 리스크 관리 정점

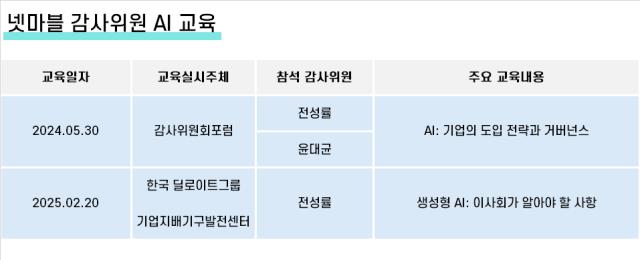

넷마블의 기업지배구조보고서를 참고하면 매년 정기적으로 사외이사

대상 AI 교육을 실시하는 것으로 보인다. 2024년 5월 감사위원회 포럼을 통해 AI 비즈니스와 가치창출 교육을 시행했다.

이듬해 2월에는 한국 딜로이트 그룹 기업지배기구발전센터로부터 '생성형 AI: 이사회가 알아야 할 사항'을 주제로 교육을 받았다. 주목할 만한 점은 AI를 독립적인 교육 주제로 삼았다는 것이다. 특히 외부 전문 컨설팅 기관을 통한 교육으로 이사회가 글로벌 규제 동향을 실시간으로 접할 수 있도록 했다.

이사회 산하 ESG위원회에서 AI 이슈를 정기적으로 보고 받는다. ESG위원회는 2021년 설립돼 2023년부터 이사회 산하 위원회로 편입됐다. 지난해 반기 보고서를 기준으로 윤대균 위원장과 이찬희, 도기욱 사외이사 3인으로 구성돼 있다. 이사회 역량 평가표에 따르면 윤대균 위원장은 디지털과 게임, IT 영역 전문가다.

넷마블은 거버넌스와 전략 및 정책, 리스크 관리, 지표 및 목표 등 4대 중대 이슈 중 거버넌스와 리스크 관리 2개 영역에 AI를 포함하고 있다. AI 관련 의사결정 체계와 위험성을 모두 관리하고 있다는 의미다.

거버넌스 영역에서는 기술 관리, 퍼블리싱 기술, AI 등 기술 조직의 협력 기구를 통해

넷마블이 추구하는 기술 개발의 방향성을 논의하고 제시한다는 목표를 설정했다. AI&Tech Lab을 설립하여 AI 기술 연구 및 개발도 진행한다. 리스크 관리에서는 AI 윤리원칙을 수립한다.

이사회에서 AI 안건만을 다룬 회의가 열리지는 않았다. ESG 위원회 활동내역에서 '2025년 ESG 중대성 평가 결과 및 이슈별 기회/리스크 분석 보고의 건', '2024년 지속가능경영 업무 성과 및 2025년 계획 보고의 건' 등이 있다. 기업지배구조보고서와 지속가능경영보고서 등을 참고하면 해당 회의에서 AI 이슈도 다뤄졌을 것으로 보인다.

이사회 구성원 중에서는 게임과 엔터테인먼트 등 신산업 전문가와 기술 전문가가 포함돼 있다. 방준혁 의장과 김병규 대표, 텐센트 게임즈에 몸담은 리나촨 기타비상무이사, 윤대균 사외이사 등이다.

◇10년 업력 'AI&Tech Lab', 바른 AI원칙으로 글로벌 표준 고수

넷마블의 AI 실무는 AI&Tech Lab에서 담당하고 있다.

CJ E&M 게임사업부문 서비스개발실장과

넷마블 R&D전략담당, HNC게임즈 감사,

넷마블 기술서비스담당 등을 거쳤다. 지난해 7월까지는 설창환 전 부사장(현

크래프톤 스튜디오 서포트 본부장)이 수장을 맡았다. 후임은 아직 정해지지 않은 것으로 보인다.

넷마블의 AI 연구 업력은 10년 이상이다. 2014년 AI 기술 연구에 착수했다. 2018년 AI 전담 연구 조직을 설립한다. 주요 AI 프로젝트로는 이미지 생성형 AI와 이상징후 탐지, 밸런싱 AI 등을 명시했다.

넷마블의 '제2의 나라: Cross Worlds' 등이 이렇게 개발한 기술을 통해 AI 모드를 활용 중이다. 음성 합성이나 강화학습 기반 게임 플레이 봇, 얼굴 애니메이션 제작, 이미지 생성 등에 AI 기술을 쓰고 있다.

별도의 AI 윤리원칙을 세워뒀다. 바른 AI다. 안전성과 공정성, 신뢰성, 개인정보 보호 등 네 갈래로 구성됐다. 눈여겨볼 만한 원칙은 편향성 배제를 위한 안전장치와 AI의 작동 방식과 의사결정의 투명성 확보 및 견고화 등이다. 유럽연합(EU)의 AI법과 궤를 같이한다. EU의 AI법은 AI의 위험도를 등급별로 나누어 규제한다.

결과적으로 실무와 전략, 감독의 3단계 의사결정 구조를 갖추고 있다. AI&Tech Lab이 기술 개발과 1차적 윤리 검수를 수행하면 전사 리스크 관리 조직이 AI 윤리 가이드라인 준수 여부를 검토한다. ESG 위원회가 중대 리스크를 보고 받고 평가해 전략을 승인한다.