대형 SI기업의 인공지능(AI) 활용은 내부 업무 효율화나 기술 시연 단계를 넘어 고객사의 핵심 업무와 통제 체계로 깊숙이 들어가고 있다. 금융·공공·제조 등 고영향 영역에 AI를 설계·구축·운영하는 만큼 SI기업에게 AI 거버넌스는 윤리 선언이나 내부 규범의 문제가 아니라 납품 가능한 관리 역량으로 인식된다.

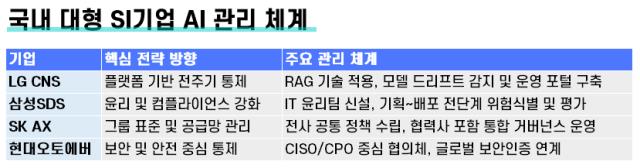

국내 대형 SI 4사는 공통적으로 이사회 및 위원회 체계 아래에서 AI 리스크를 관리하고 있지만 각 사의 사업 포지션과 고객군에 따라 거버넌스의 초점은 다르게 형성돼 있다. 글로벌 빅테크처럼 AI 전문 사외이사나 전용 위원회를 전면에 내세우는 방식과는 결이 다르다.

이들은 고객사가 요구하는 규제 준수와 통제 가능성을 중심으로 거버넌스를 설계했다. AI 기본법 시행과 함께 공공·금융 발주 기준이 강화될수록 SI기업의 경쟁력은 기술 속도보다 관리 체계의 완성도에 의해 좌우될 가능성이 크다.

◇플랫폼·윤리·표준·보안…AI 거버넌스도 SI 색깔대로 LG CNS는 기업용 AI 플랫폼을 전면에 내세운다. 데이터 수집부터 활용까지 데이터 거버넌스 전 생애주기를 제공하고 분석·운영 포털을 통해 모델 재학습과 드리프트 감지 등 운영 통제를 강조한다. 생성형 AI 확산에 맞춰 기업 내부 지식자산을 안전하게 활용하도록 설계한 점이 특징이다. AI를 서비스가 아닌 플랫폼 관리

대상으로 규정하면서 고객사가 자체 통제체계를 갖출 수 있도록 지원하는 구조다.

삼성SDS는 AI 위험을 윤리·컴플라이언스 영역으로 분리해 관리한다. AI 위험관리 중심의 전담 조직인 IT윤리팀을 신설해 기획·개발·배포·운영 전 과정에서 위험을 식별·평가·완화한다고 명시돼 있다. ESG위원회 안건으로 AI경영시스템 인증 추진을 보고하는 등 이사회 산하 위원회와의 연계를 강화했다. 유해 답변 유형 분류와 내부 가이드 운영은 고객 접점 AI의 리스크를 선제적으로 통제하려는 시도로 읽힌다.

SK AX는 그룹 공통의 디지털 책임과 보안·윤리 기준에 맞춘 거버넌스 운용을 강조한다. 개별 프로젝트 관리보다 공급망과 파트너까지 고려한 기준 정합성이 특징이다. 고객사를 대신해 AI를 구축·운영하는 SI 특성을 고려해 정책·표준을 우선 정립하고 실무 조직에서 이를 적용하는 방식이다. AI를 독립 의제로 부각하기보다는 ESG·보안 프레임 안에서 관리하는 전형적 실무형 접근이다.

현대오토에버는 모빌리티·제조 IT 특성을 반영해 정보보호·프라이버시 거버넌스를 AI 관리의 기반으로 둔다. CISO·CPO를 지정하고 정기 협의체를 운영하며 글로벌 표준(ISO 27001, ISMS, 클라우드 보안 인증 등)에 따라 관리체계를 고도화했다. AI를 별도 윤리 의제로 분리하기보다는 데이터·보안·품질 관리 체계 안에서 통합적으로 다룬다. 이는 차량 SW·스마트팩토리 등 고위험 환경에서의 안정성을 우선한 선택으로 풀이된다.

◇해외 AI 거버넌스 한발 앞 서 해외 SI 기업들의 공통점은 AI를 기술 경쟁력의 상징이 아니라 통제해야 할 경영 변수로 본다는 점이다. 이사회 또는 최고경영진이 AI 거버넌스를 직접 감독하고 전담 조직을 통해 프로젝트 단위의 리스크를 상시 점검한다. 또 고객사와의 계약·운영 단계에서 AI 책임 범위를 명확히 하는 등 거버넌스를 사업 구조 안에 내재화했다. 거버넌스를 설계하는 방식에서는 국내 기업들보다 한 발 앞서 있다는 평가다.

국내 대형 SI들이 ESG·보안·리스크 위원회 틀 안에서 AI를 관리하고 있다면 해외 SI들은 한 단계 더 나아가 AI 자체를 독립적인 관리

대상으로 끌어올린 셈이다. 향후 AI 기본법과 글로벌 규제 환경이 본격화될수록 이 같은 해외 사례는 국내 SI 기업들의 거버넌스 고도화 논의에서 비교 기준점으로 작용할 가능성이 크다.

대표적으로 액센츄어(Accenture)는 AI를 사업 리스크로 정의하고 이사회 감독 아래 전사 차원의 책임체계를 구축했다. 액센츄어는 Responsible AI 프레임워크를 통해 AI 전략, 윤리, 법·규제, 운영 통제를 하나의 체계로 묶었다. 프로젝트 단위가 아니라 기업 전반에서 AI 사용 사례를 분류하고 고위험 영역은 사전 심의와 경영진 승인을 거치도록 설계했다. 특히 고객사를 대신해 AI 시스템을 구축하는 경우 책임의 경계와 통제 범위를 계약 단계에서 명시하는 점을 강조한다.

IBM은 보다 구조화된 접근을 택했다. IBM은 AI 윤리위원회(AI Ethics Board)와 별도의 AI 윤리부서(AI Ethics Office)를 운영하며 정책 수립과 실행을 분리했다. 생성형 AI와 자동화 기술이 고객 의사결정에 미치는 영향을 중대 리스크로 분류하고 모든 AI 프로젝트에 대해 영향 평가(AI Impact Assessment)를 수행한다. 특히 고객사 시스템에 적용되는 AI의 경우 설명 가능성, 데이터 출처, 편향 통제 방식을 문서화해 제공하도록 요구한다. SI로서 고객사의 규제 대응을 지원해야 한다는 인식이 반영된 구조다.

유럽계 SI 기업들도 비슷한 흐름을 보인다. 캡재미니(Capgemini)는 AI 윤리를 ESG 전략의 일부로 편입시켰다. 캡제미니는 AI를 활용한 프로젝트가 유럽연합(EU)의 AI 법안(AI Act)상 어떤 위험군에 속하는지를 사전에 분류하고 고위험 AI는 별도의 승인 프로세스를 거치도록 했다. 단순한 내부 통제에 그치지 않고 고객과 공동으로 리스크를 평가하는 구조를 만든 점이 특징이다.